Технические науки/ 6. Энергетика

К.т.н. Шпрехер Д.М.

Новомосковский институт РХТУ им. Д.И.

Менделеева,Россия

Прогнозная экстраполяция параметров

электромеханических систем в нейросетевом базисе

Для успешного распознавания технических состояний (ТС) с помощью нейронных сетей (НС) необходимо каким-то образом описать общие признаки, характеризующие работоспособность и неработоспособность электромеханических систем (ЭМС).

Математическая суть процедуры

обучения экстраполяции в пространстве состоит в следующем: пусть имеется

возможность моделировать различные состояния ЭМС, причем заранее известно,

какое из них является работоспособным, а какое – неработоспособным.

Моделируемые состояния ЭМС будем называть обучающими. Представим обучающие состояния

в виде подпространства ![]() , а каждое отдельное состояние в виде точки этого

подпространства, описываемой

, а каждое отдельное состояние в виде точки этого

подпространства, описываемой ![]() - мерным вектором

параметров объекта:

- мерным вектором

параметров объекта: ![]() , где: T – символ транспонирования,

, где: T – символ транспонирования, ![]() - размерность

вектора параметров ЭМС,

- размерность

вектора параметров ЭМС, ![]() – размерность вектора

переменных состояния ЭМС: выходные воздействия и сигналы, реализующие функции

применения ЭМС по своему предназначению,

– размерность вектора

переменных состояния ЭМС: выходные воздействия и сигналы, реализующие функции

применения ЭМС по своему предназначению, ![]() – размерность вектора

конструктивных параметров ЭМС.

– размерность вектора

конструктивных параметров ЭМС.

Поскольку моделируемые состояния заранее известны, то целесообразно все

подпространство ![]() представить в виде

двух непересекающихся областей. Обозначим полученные области работоспособного и

неработоспособного состояния ЭМС в виде фактор-множества

представить в виде

двух непересекающихся областей. Обозначим полученные области работоспособного и

неработоспособного состояния ЭМС в виде фактор-множества ![]() , где

, где ![]() ,

, ![]() - показатель качества

функционирования ЭМС по

- показатель качества

функционирования ЭМС по ![]() , характеризующий средний риск. Другими словами: всё исходное

множество обучающих состояний

, характеризующий средний риск. Другими словами: всё исходное

множество обучающих состояний ![]() разбивается на две

области с учетом значений показателя (фактора)

разбивается на две

области с учетом значений показателя (фактора) ![]() и

и ![]() . При этом область

. При этом область ![]() должна содержать в

себе обучающие состояния, соответствующие работоспособной ЭМС и удовлетворяющие

условию:

должна содержать в

себе обучающие состояния, соответствующие работоспособной ЭМС и удовлетворяющие

условию: ![]() . Тогда область

. Тогда область ![]() , должна содержать

в себе обучающие состояния, соответствующие

неработоспособному состоянию ЭМС:

, должна содержать

в себе обучающие состояния, соответствующие

неработоспособному состоянию ЭМС: ![]() .

.

Для реализации указанного разбиения элементы фактор-множества ![]() должны находиться в отношении эквивалентности.

Поскольку показатель

должны находиться в отношении эквивалентности.

Поскольку показатель ![]() характеризует средний

риск, то

характеризует средний

риск, то ![]() .

.

Данное значение может быть достигнуто только при номинальных значениях конструктивных

параметров ЭМС и требуемой траектории

изменения параметров ТС. Поэтому в дальнейшем будем считать, что для

работоспособных состояний показатель ![]() должен

удовлетворять только условию

должен

удовлетворять только условию ![]() , а для неработоспособных

, а для неработоспособных ![]() .

.

Сформулируем математически задачу обучения. Пусть задана прогнозная

модель ЭМС в виде: ![]() , где:

, где:![]() – вектор переменных технического состояния ЭМС в момент

времени контроля

– вектор переменных технического состояния ЭМС в момент

времени контроля ![]() на периоде основания

прогноза

на периоде основания

прогноза ![]() :

:![]() ;

; ![]() - оператор функционирования (смены ТС) ЭМС;

- оператор функционирования (смены ТС) ЭМС; ![]() – начальное техническое состояние ЭМС;

– начальное техническое состояние ЭМС; ![]() – вектор конструктивных параметров ЭМС:

– вектор конструктивных параметров ЭМС:![]() ;

; ![]() - реализация входного

воздействия на интервале

- реализация входного

воздействия на интервале ![]() .

.

Математическая основа экстраполяционной модели позволяет воспроизводить

как работоспособные, так и неработоспособные состояния в подпространстве ![]() . Предположим, что заранее известна требуемая фазовая траектория

. Предположим, что заранее известна требуемая фазовая траектория ![]() , (т.е. известно, как должна вести себя ЭМС в ходе применения

по назначению), а также, известна верхняя граница

, (т.е. известно, как должна вести себя ЭМС в ходе применения

по назначению), а также, известна верхняя граница ![]() для обобщенного

показателя качества

для обобщенного

показателя качества ![]() . Пусть задана также размерность

. Пусть задана также размерность ![]() пространства

конструктивных параметров

пространства

конструктивных параметров ![]() , но априорные условные плотности распределения вероятностей

их отдельных значений – неизвестны.

, но априорные условные плотности распределения вероятностей

их отдельных значений – неизвестны.

Существует доказательство теоремы [1], утверждающей, что с помощью линейных комбинаций и суперпозиций линейных функций и одной произвольной нелинейной функции одного аргумента можно сколь угодно точно приблизить любую непрерывную функцию многих переменных. Из этой теоремы следует, что многослойные нейронные сети (НС) – универсальные аппроксимирующие математические инструменты и могут с любой точностью имитировать любую функцию многих переменных.

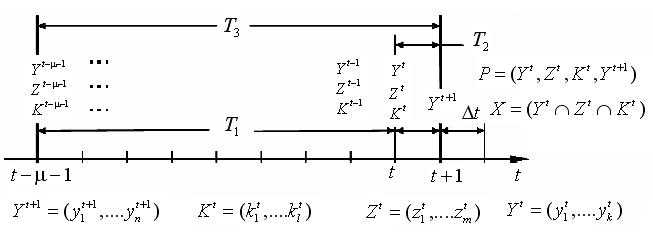

Алгоритм обучения экстраполирующей НС применяется для синтеза моделей многомерного прогнозирования параметров в рамках широко распространенного метода погружения (метода скользящего окна), кратко, суть которого заключается в следующем [2].

Весь объем информации (протокол наблюдений ЭМС), на основании которой строится

прогноз ее параметров, представляется отдельными ситуациями - ![]() , где

, где ![]() – число наблюдений. Соответственно,

каждая наблюдаемая ситуация протокола

– число наблюдений. Соответственно,

каждая наблюдаемая ситуация протокола ![]() :

: ![]() представляется в обобщенном виде

представляется в обобщенном виде ![]() ), где

), где ![]() - вектор параметров

состояния ЭМС, относящихся к причинам прогнозируемых явлений (иначе вектор

текущего состояния ЭМС);

- вектор параметров

состояния ЭМС, относящихся к причинам прогнозируемых явлений (иначе вектор

текущего состояния ЭМС); ![]() - вектор факторов

прогнозного фона ЭМС;

- вектор факторов

прогнозного фона ЭМС; ![]() - вектор,

характеризующий управляющие воздействия либо текущие режимы функционирования ЭМС;

- вектор,

характеризующий управляющие воздействия либо текущие режимы функционирования ЭМС;

![]() - вектор параметров ЭМС,

принимаемых в качестве прогнозируемого следствия. Совокупность векторов

- вектор параметров ЭМС,

принимаемых в качестве прогнозируемого следствия. Совокупность векторов ![]() образуют причину

образуют причину ![]() следствия

следствия ![]() . Временная диаграмма ситуации

. Временная диаграмма ситуации ![]() представлена на рис. 1.

На рисунке:

представлена на рис. 1.

На рисунке: ![]() - количество отсчетов

(размер окна наблюдения системы) наблюдения системы,

- количество отсчетов

(размер окна наблюдения системы) наблюдения системы, ![]() – интервал упреждения.

Интервал упреждения на рисунке соответствует одному отсчету. Отсчеты следуют с

интервалом

– интервал упреждения.

Интервал упреждения на рисунке соответствует одному отсчету. Отсчеты следуют с

интервалом ![]() .

.

Рис.1. Временная диаграмма обучающей ситуации – скользящего окна наблюдения параметров ЭМС.

На интервале наблюдения ![]() , с шагом

, с шагом ![]() наблюдаются вектор

параметров технического состояния ЭМС -

наблюдаются вектор

параметров технического состояния ЭМС - ![]() , вектор факторов окружающей среды для ЭМС -

, вектор факторов окружающей среды для ЭМС - ![]() и фиксируются

управляющие воздействия на ЭМС –

и фиксируются

управляющие воздействия на ЭМС – ![]() , в момент времени

, в момент времени ![]() осуществляется

прогноз вектора параметров ТС ЭМС –

осуществляется

прогноз вектора параметров ТС ЭМС – ![]() , также с упреждением

, также с упреждением ![]() . Ситуация

прогнозирования, занимающая интервал

. Ситуация

прогнозирования, занимающая интервал ![]() , отличается от обучающей ситуация тем, что при обучении

прогнозный вектор

, отличается от обучающей ситуация тем, что при обучении

прогнозный вектор ![]() и массив наблюдений

и массив наблюдений ![]() на периоде

на периоде ![]() – известны. При этом,

массив наблюдений, накопленный на периоде

– известны. При этом,

массив наблюдений, накопленный на периоде ![]() подается на вход НС,

а вектор

подается на вход НС,

а вектор ![]() на выход. Смещая по

оси времени весь интервал

на выход. Смещая по

оси времени весь интервал ![]() , формируются строки обучающей выборки .

, формируются строки обучающей выборки .

Смещая ![]() раз по временной оси

длительность

раз по временной оси

длительность ![]() с шагом

с шагом ![]() можно получить

упорядоченные протоколом наблюдения множество входных векторов

можно получить

упорядоченные протоколом наблюдения множество входных векторов ![]() и выходных следствий

и выходных следствий ![]() , т.е. обучающую выборку.

, т.е. обучающую выборку.

Если полученную таким путем выборку представить как числовой массив, каждая строка, которого соответствует одному отсчету (временному срезу наблюдения совокупности параметров системы), а каждый столбец как последовательность значений одного параметра, то период упреждения прогноза определяет число строк находящихся между последней строкой, вошедшей во входной вектор и строкой преобразованной в выходной вектор. Размерность выходного (целевого) вектора обучающей выборки всегда соответствует числу параметров системы.

В общем случае, целью процесса обучения экстраполирующей НС является настройка множества весов НС таким образом, чтобы удовлетворить некоторому критерию обучения, например, минимуму среднеквадратической ошибки сети.

Процесс обучения многослойной НС является итерационным и, неопределенно

длительным.. Одним из способов настройки весов для экстраполирующей НС может

служить нейросетевая реализация классификатора по методу потенциальных функций,

позволяющая строить гиперповерхности в ![]() -мерном пространстве параметров

модели ЭМС.

-мерном пространстве параметров

модели ЭМС.

Представим класс ![]() прогнозируемого ТС

ЭМС как функцию

прогнозируемого ТС

ЭМС как функцию ![]() суммы результатов

классификации по

суммы результатов

классификации по ![]() -му и

-му и ![]() -му признакам -

-му признакам - ![]() c учетом коэффициента

c учетом коэффициента

![]() :

:

,

,

где ![]() – количество

признаков ТС ЭМС.

– количество

признаков ТС ЭМС.

Условимся, что класс ![]() – работоспособного ТС

ЭМС будет кодироваться значением 1, а класс

– работоспособного ТС

ЭМС будет кодироваться значением 1, а класс ![]() – неработоспособного

состояния – значением 0.

– неработоспособного

состояния – значением 0.

Для определения результатов классификации по ![]() -му и

-му и ![]() -му признакам

-му признакам ![]() для измерения

для измерения ![]() найдем расстояния

этого экземпляра от центров сосредоточения измерений, принадлежащих классам А и

В, на плоскости, образованной

найдем расстояния

этого экземпляра от центров сосредоточения измерений, принадлежащих классам А и

В, на плоскости, образованной ![]() -м и

-м и ![]() -м признаками:

-м признаками:

![]() ,

,

где:  , координаты центров (центроиды) разброса измерений

принадлежащих к классу A

и классу B,

, координаты центров (центроиды) разброса измерений

принадлежащих к классу A

и классу B, ![]() – расстояние от

центроидов до точек измерений (координат измерений),

– расстояние от

центроидов до точек измерений (координат измерений), ![]() - количество

работоспособных технических состояний ЭМС,

- количество

работоспособных технических состояний ЭМС, ![]() - количество неработоспособных

технических состояний ЭМС.

- количество неработоспособных

технических состояний ЭМС.

Если ![]() , то будем считать, что на плоскости

, то будем считать, что на плоскости ![]() (работоспособному

состоянию), иначе

(работоспособному

состоянию), иначе ![]() (неработоспособному

состоянию). Следовательно, если

(неработоспособному

состоянию). Следовательно, если ![]() , то

, то ![]() = 1, иначе

= 1, иначе ![]() = 0.

= 0.

Для нейросетевой реализации сравнения расстояний и определения значения ![]() можно использовать

следующее выражение:

можно использовать

следующее выражение:

![]() ,

,

где ![]() – сигмоидная функция

активации.

– сигмоидная функция

активации.

Если функция ![]() дискретная, например,

пороговая:

дискретная, например,

пороговая:  , то

, то ![]() будет принимать значение

0 или 1. Если функция

будет принимать значение

0 или 1. Если функция ![]() непрерывная,

например,

непрерывная,

например,  , то

, то ![]() будет принимать значения на интервале

[0,1]: чем ближе значение этой функции будет к 0, тем ближе прогнозируемое техническое

состояние ЭМС будет к классу, которому сопоставлено значение 0, и,

соответственно, наоборот, чем ближе значение этой функции будет к 1, тем ближе

прогнозируемое ТС будет к классу, которому сопоставлено значение 1.

Использование сигмоидной функции может быть более предпочтительным на практике,

поскольку она позволяет не только определить, к какому классу ближе экземпляр,

но и насколько ближе.

будет принимать значения на интервале

[0,1]: чем ближе значение этой функции будет к 0, тем ближе прогнозируемое техническое

состояние ЭМС будет к классу, которому сопоставлено значение 0, и,

соответственно, наоборот, чем ближе значение этой функции будет к 1, тем ближе

прогнозируемое ТС будет к классу, которому сопоставлено значение 1.

Использование сигмоидной функции может быть более предпочтительным на практике,

поскольку она позволяет не только определить, к какому классу ближе экземпляр,

но и насколько ближе.

В качестве шаблона нейросетевой реализации прогнозирующей НС можно использовать стандартную НС, предназначенную для текущего контроля и распознавания ТС ЭМС.

В каждом такте обучения прогнозной экстраполирующей модели процедура обучения

оперирует одновременно с одной из ![]() пар векторов из входного

и соответствующего ему выходного пространств, составляющих множество элементов

обучения

пар векторов из входного

и соответствующего ему выходного пространств, составляющих множество элементов

обучения ![]() размерности

размерности ![]() . После

. После ![]() -го предъявления на вход многослойной сети всех элементов одной

пары векторов (

-го предъявления на вход многослойной сети всех элементов одной

пары векторов (![]() -я обучающая итерация), оценивается значение суммарной

выходной среднеквадратичной ошибки перцептрона:

-я обучающая итерация), оценивается значение суммарной

выходной среднеквадратичной ошибки перцептрона:

,

,

где: вектор ![]() соответствует

«истинному» вектору из обучающего набора, а вектор

соответствует

«истинному» вектору из обучающего набора, а вектор ![]() представляет собой

результат нейросетевой обработки входного сигнала

представляет собой

результат нейросетевой обработки входного сигнала ![]() в

в ![]() -й эпохе.

-й эпохе.

Подстройка весовой матрицы ![]() осуществляется

минимизацией функционала и итерированием по эпохам обучения с помощью различных

оптимизационных постановок алгоритма обратного распространения [2]:

осуществляется

минимизацией функционала и итерированием по эпохам обучения с помощью различных

оптимизационных постановок алгоритма обратного распространения [2]:

где ![]() ,

, ![]() - параметры алгоритма, определяющие

скорость и устойчивость итерационного процесса обучения экстраполирующей НС.

- параметры алгоритма, определяющие

скорость и устойчивость итерационного процесса обучения экстраполирующей НС.

Вывод.

1. Разработаны нейросетевые реализации моделей прогнозной экстраполяции в пространстве признаков прецедентов.

2. Представлена линейная сеть, представляющая комбинацию независимых базисных функций прогнозирования области работоспособности.

3. Представлена экстраполяционная многослойная НС прямого распространения в качестве прогнозной модели ЭМС на основе многомерного метода погружения (метода скользящего окна).

4. Представлен способ настройки

весов для экстраполирующей НС, обеспечивающий нейросетевую реализацию

классификатора по методу потенциальных функций, и позволяющий, в свою очередь

строить гиперповерхности в ![]() -мерном пространстве параметров

модели ЭМС.

-мерном пространстве параметров

модели ЭМС.

Литература:

1. Горбань А.Н. Обобщенная аппроксимационная теорема и вычислительные возможности нейронных сетей // Сибирский журнал вычислительной математики. РАН. Сиб. Отд. Новосибирск, 1998. т. 1, № 1, с. 11-24.

2. Осовский С. Нейронные сети для обработки информации //Пер с польского. М., Финансы и статистика, 2002. 344 с.

,

,